Por que é necessário gerar e analisar dados?

Imagine tentar navegar em um oceano desconhecido sem instrumentos de orientação. Esta é a realidade de empresas que tomam decisões sem uma base sólida de dados. No cenário empresarial atual, caracterizado por rápidas mudanças e alta competitividade, cada decisão precisa ser fundamentada em evidências concretas. A geração e coleta sistemática de dados transformam elementos intangíveis como comportamentos, preferências e tendências em informações mensuráveis e acionáveis. Quando devidamente analisados, estes dados revelam padrões ocultos, correlações inesperadas e oportunidades que passariam despercebidas ao olho humano. Sem esta base analítica, as organizações ficam vulneráveis a:- Decisões baseadas em suposições ou experiências pessoais limitadas

- Incapacidade de identificar tendências emergentes no mercado

- Dificuldade em compreender profundamente o comportamento dos clientes

- Ineficiências operacionais que permanecem invisíveis até causarem problemas significativos

O que é análise de dados?

A análise de dados é o processo sistemático de examinar, limpar, transformar e interpretar informações com o objetivo de descobrir padrões úteis, extrair conclusões relevantes e apoiar a tomada de decisões estratégicas.

Mais do que uma simples coleta de números, a análise de dados é uma disciplina que combina estatística, matemática, programação e conhecimento de negócios para transformar dados brutos em conhecimento aplicável. É a ponte que conecta o que está acontecendo em sua empresa (dados) ao entendimento do porquê isto está acontecendo (insights) e à determinação do que fazer a respeito (ações).

Além disso, esta disciplina abrange desde análises básicas em planilhas até modelos complexos de aprendizado de máquina que podem prever comportamentos futuros com precisão. O denominador comum é sempre o mesmo: extrair valor de informações que, isoladamente, teriam pouco significado prático.

A análise de dados é o processo sistemático de examinar, limpar, transformar e interpretar informações com o objetivo de descobrir padrões úteis, extrair conclusões relevantes e apoiar a tomada de decisões estratégicas.

Mais do que uma simples coleta de números, a análise de dados é uma disciplina que combina estatística, matemática, programação e conhecimento de negócios para transformar dados brutos em conhecimento aplicável. É a ponte que conecta o que está acontecendo em sua empresa (dados) ao entendimento do porquê isto está acontecendo (insights) e à determinação do que fazer a respeito (ações).

Além disso, esta disciplina abrange desde análises básicas em planilhas até modelos complexos de aprendizado de máquina que podem prever comportamentos futuros com precisão. O denominador comum é sempre o mesmo: extrair valor de informações que, isoladamente, teriam pouco significado prático.

Como funciona a análise de dados?

A jornada dos dados até se transformarem em decisões estratégicas segue um percurso estruturado que pode ser dividido em etapas claras e sequenciais, seguindo a mesma lógica do Machine Learning:1ª Etapa: Coleta de dados

O processo começa com a reunião de informações relevantes de diversas fontes. Estes dados podem vir de sistemas internos (como CRMs e ERPs), pesquisas de mercado, redes sociais, sensores IoT, interações com clientes e inúmeras outras origens. A chave nesta fase é garantir a captura de dados relevantes para as questões que se deseja responder.2ª Etapa: Preparação dos dados

Os dados raramente chegam prontos para análise. Esta etapa envolve a limpeza e organização das informações, incluindo:- Remoção de duplicidades e inconsistências

- Tratamento de valores ausentes ou incorretos

- Padronização de formatos

- Estruturação para facilitar a análise subsequente

3ª Etapa: Análise exploratória

Com os dados preparados, inicia-se uma investigação preliminar para compreender suas características fundamentais. Esta etapa revela distribuições, correlações iniciais e possíveis anomalias, orientando análises mais aprofundadas e ajudando a formular hipóteses relevantes.4ª Etapa: Modelagem de dados

Aqui entram as técnicas estatísticas e algoritmos que transformam dados em insights. Dependendo do objetivo, pode-se aplicar:- Métodos estatísticos tradicionais

- Algoritmos de aprendizado de máquina

- Técnicas de visualização avançada

- Modelos preditivos e prescritivos

5ª Etapa: Interpretação e comunicação

Mesmo as análises mais sofisticadas têm valor limitado se não forem comunicadas efetivamente. Esta etapa final traduz resultados técnicos em narrativas compreensíveis e recomendações acionáveis, frequentemente utilizando visualizações intuitivas para facilitar o entendimento pelos stakeholders.Quais os tipos de análise de dados?

A análise de dados pode ser categorizada em quatro tipos principais, cada um respondendo a diferentes questões e oferecendo perspectivas complementares:

A análise de dados pode ser categorizada em quatro tipos principais, cada um respondendo a diferentes questões e oferecendo perspectivas complementares:

Análise descritiva

Responde à pergunta: "O que aconteceu?" É o ponto de partida da jornada analítica, focando em resumir e descrever dados históricos. Utilizando métricas como médias, medianas, frequências e outros indicadores estatísticos, esta abordagem permite compreender o cenário atual e estabelecer uma linha de base para comparações futuras. Exemplo prático: Relatórios de vendas mensais que mostram volumes, crescimento percentual e desempenho por região ou produto.Análise diagnóstica

Responde à pergunta: "Por que aconteceu?" Vai além da descrição para investigar causas e correlações. Utilizando técnicas como análise de correlação, drill-down e comparações, busca explicar os motivos por trás dos padrões observados na análise descritiva. Exemplo prático: Identificar que a queda nas vendas em determinada região coincide com a entrada de um novo concorrente e mudanças climáticas sazonais.Análise preditiva

Responde à pergunta: "O que provavelmente acontecerá?" Utiliza dados históricos para identificar padrões e prever tendências futuras. Através de modelos estatísticos e algoritmos de aprendizado de máquina, esta abordagem permite antecipar cenários e se preparar proativamente. Exemplo prático: Prever a demanda futura de produtos com base em sazonalidade, tendências de mercado e comportamento de consumo histórico.Análise prescritiva

Responde à pergunta: "O que devemos fazer a respeito?" Representa o estágio mais avançado, combinando insights das análises anteriores para recomendar ações específicas. Utilizando otimização, simulação e inteligência artificial, esta abordagem sugere os melhores caminhos a seguir. Exemplo prático: Recomendações automatizadas de ajustes de preços baseadas em elasticidade da demanda, ações da concorrência e objetivos de margem.Diferenças entre Data Analytics, Data Science e Big Data

Embora frequentemente usados de forma intercambiável, estes termos representam conceitos distintos com focos e abordagens específicas:Data Analytics (Análise de Dados)

Foca na extração de insights e informações úteis a partir de conjuntos de dados existentes para responder a perguntas específicas de negócios. É tipicamente retrospectiva e orientada por hipóteses, utilizando técnicas estatísticas e ferramentas de visualização para interpretar o que os dados revelam sobre eventos passados e presentes. Público principal: Analistas de negócios e gerentes que precisam tomar decisões baseadas em evidências.Data Science (Ciência de Dados)

Campo multidisciplinar mais amplo que combina estatística, matemática, programação e conhecimento de domínio para extrair conhecimento e insights de dados em diversas formas. Vai além da análise para incluir a criação de algoritmos, modelos preditivos avançados e sistemas automatizados de tomada de decisão. Público principal: Cientistas de dados, pesquisadores e desenvolvedores de soluções analíticas avançadas.Big Data

Refere-se especificamente aos conjuntos de dados massivos caracterizados pelos "3 Vs": Volume: Dados em escala que excedem a capacidade de ferramentas tradicionais Velocidade: Geração e processamento em tempo real ou quase real Variedade: Diversidade de formatos e fontes, incluindo dados estruturados e não estruturados Big Data é mais um desafio tecnológico e metodológico do que uma disciplina analítica em si, exigindo infraestruturas especializadas para armazenamento e processamento. Público principal: Arquitetos de dados, engenheiros e especialistas em infraestrutura tecnológica.A profissão de analista de dados: muito além dos números

Contrariamente ao que dizem, o papel do analista de dados vai muito além de simplesmente mover informações de um sistema para outro ou gerar relatórios padronizados. É uma função multifacetada que combina habilidades técnicas, visão estratégica e capacidade de comunicação.

O analista de dados atua como um verdadeiro tradutor, convertendo dados brutos em narrativas que impulsionam decisões. Sua jornada começa com o levantamento de requisitos de negócios, compreendendo o contexto e as questões que precisam ser respondidas. Em seguida, ele identifica as fontes de dados relevantes, avalia sua qualidade e estabelece conexões entre diferentes conjuntos de informações.

Imagine que os dados são como peças de LEGO espalhadas: o analista não apenas as organiza, mas também visualiza e constrói o castelo completo que elas podem formar. Ele identifica padrões invisíveis aos olhos destreinados, estabelece relações causais e projeta cenários futuros baseados em tendências históricas.

Para exercer esta função com excelência, um analista de dados precisa dominar:

Ferramentas técnicas: SQL, Excel, Python, R, Power BI e outras tecnologias de manipulação e visualização de dados

Pensamento analítico: Capacidade de estruturar problemas complexos e abordar questões de forma sistemática

Conhecimento estatístico: Compreensão de conceitos fundamentais como distribuições, correlações e significância

Visão de negócios: Entendimento do contexto e dos objetivos estratégicos da organização

Comunicação eficaz: Habilidade para traduzir análises técnicas em insights compreensíveis para diferentes públicos

Contrariamente ao que dizem, o papel do analista de dados vai muito além de simplesmente mover informações de um sistema para outro ou gerar relatórios padronizados. É uma função multifacetada que combina habilidades técnicas, visão estratégica e capacidade de comunicação.

O analista de dados atua como um verdadeiro tradutor, convertendo dados brutos em narrativas que impulsionam decisões. Sua jornada começa com o levantamento de requisitos de negócios, compreendendo o contexto e as questões que precisam ser respondidas. Em seguida, ele identifica as fontes de dados relevantes, avalia sua qualidade e estabelece conexões entre diferentes conjuntos de informações.

Imagine que os dados são como peças de LEGO espalhadas: o analista não apenas as organiza, mas também visualiza e constrói o castelo completo que elas podem formar. Ele identifica padrões invisíveis aos olhos destreinados, estabelece relações causais e projeta cenários futuros baseados em tendências históricas.

Para exercer esta função com excelência, um analista de dados precisa dominar:

Ferramentas técnicas: SQL, Excel, Python, R, Power BI e outras tecnologias de manipulação e visualização de dados

Pensamento analítico: Capacidade de estruturar problemas complexos e abordar questões de forma sistemática

Conhecimento estatístico: Compreensão de conceitos fundamentais como distribuições, correlações e significância

Visão de negócios: Entendimento do contexto e dos objetivos estratégicos da organização

Comunicação eficaz: Habilidade para traduzir análises técnicas em insights compreensíveis para diferentes públicos

Microsoft Fabric: transformando a análise de dados empresarial

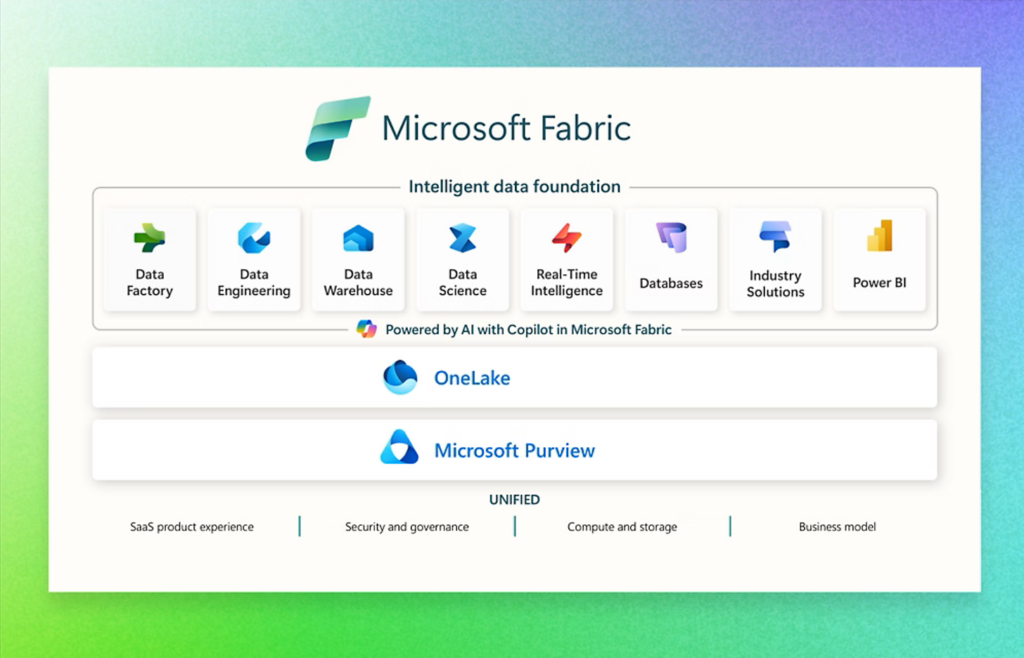

No universo das ferramentas de análise, o Microsoft Fabric emerge como uma solução revolucionária, especialmente para empresas que já utilizam o ecossistema Microsoft. Lançada em 2023, esta plataforma unificada de análise baseada na nuvem representa uma evolução significativa na forma como as organizações gerenciam seu ciclo de vida de dados.

O diferencial do Microsoft Fabric está em sua abordagem integrada, eliminando a necessidade de múltiplas ferramentas desconectadas e simplificando o fluxo de trabalho analítico de ponta a ponta. A plataforma reúne componentes essenciais em um ambiente unificado:

OneLake: Um repositório centralizado que funciona de maneira semelhante ao OneDrive, mas otimizado para dados analíticos de grande escala

Data Factory: Ferramentas para orquestração, movimentação e transformação de dados entre diferentes fontes e destinos

Data Engineering: Recursos para coletar, processar e analisar grandes volumes de dados complexos

Data Warehouse: Sistema para armazenamento centralizado e otimizado para consultas analíticas

Power BI: Capacidades de visualização e relatórios interativos integrados nativamente à plataforma

Data Science: Ferramentas para análise avançada e implementação de modelos de inteligência artificial

Esta integração permite que equipes colaborem de forma mais eficiente, eliminando silos e garantindo uma única fonte de verdade para toda a organização. Para empresas que buscam escalar suas capacidades analíticas, o Microsoft Fabric oferece uma abordagem coesa que reduz a complexidade técnica e acelera o tempo de obtenção de insights.

| Leia a matéria completa em Microsoft Fabric: O que é e para o que serve?

No universo das ferramentas de análise, o Microsoft Fabric emerge como uma solução revolucionária, especialmente para empresas que já utilizam o ecossistema Microsoft. Lançada em 2023, esta plataforma unificada de análise baseada na nuvem representa uma evolução significativa na forma como as organizações gerenciam seu ciclo de vida de dados.

O diferencial do Microsoft Fabric está em sua abordagem integrada, eliminando a necessidade de múltiplas ferramentas desconectadas e simplificando o fluxo de trabalho analítico de ponta a ponta. A plataforma reúne componentes essenciais em um ambiente unificado:

OneLake: Um repositório centralizado que funciona de maneira semelhante ao OneDrive, mas otimizado para dados analíticos de grande escala

Data Factory: Ferramentas para orquestração, movimentação e transformação de dados entre diferentes fontes e destinos

Data Engineering: Recursos para coletar, processar e analisar grandes volumes de dados complexos

Data Warehouse: Sistema para armazenamento centralizado e otimizado para consultas analíticas

Power BI: Capacidades de visualização e relatórios interativos integrados nativamente à plataforma

Data Science: Ferramentas para análise avançada e implementação de modelos de inteligência artificial

Esta integração permite que equipes colaborem de forma mais eficiente, eliminando silos e garantindo uma única fonte de verdade para toda a organização. Para empresas que buscam escalar suas capacidades analíticas, o Microsoft Fabric oferece uma abordagem coesa que reduz a complexidade técnica e acelera o tempo de obtenção de insights.

| Leia a matéria completa em Microsoft Fabric: O que é e para o que serve?

Conclusão: transformando dados em vantagem competitiva

A análise de dados não é apenas uma disciplina técnica, mas um imperativo estratégico para organizações que desejam prosperar na economia digital. À medida que o volume e a complexidade dos dados continuam crescendo exponencialmente, a capacidade de extrair valor dessas informações torna-se uma competência fundamental. Para empresas iniciando sua jornada analítica, recomendamos:- Começar com perguntas claras de negócios, não com tecnologias

- Investir em qualidade e governança de dados desde o início

- Capacitar equipes com as habilidades necessárias para interpretar análises

- Escolher ferramentas que se alinhem com a maturidade e objetivos da organização

- Cultivar uma cultura baseada em evidências, onde decisões são fundamentadas em dados